Brauchen wir spezielle Rechte für die Nutzung?

„Das Bewusstsein für mögliche Risiken ist eher gering ausgeprägt“

© berkahlineart - stock.adobe.com

„Das Bewusstsein für mögliche Risiken ist eher gering ausgeprägt“

© berkahlineart - stock.adobe.com

Herr Prof. Wood, das Europaparlament hat Sie vor Kurzem zu einem Workshop eingeladen, in dem Neurorechte als „letzte Verteidigungslinie der Privatsphäre“ bezeichnet wurden. Was ist mit dem Begriff gemeint – und warum ist es wichtig, über das Thema zu diskutieren?

Mit Neurorechten bezeichnet man spezielle Schutzrechte für das Nervensystem. Darüber zu reden ist wichtig, weil neue Technologien immer mehr Möglichkeiten bieten werden, unser Denken und Verhalten zu überwachen oder zu beeinflussen. Der in New York ansässige Thinktank „Neurorights Foundation“ fordert sogar ein neues Menschenrecht auf Gedankenfreiheit. In unserer im Juli veröffentlichten Studie für das Europaparlament kommen meine Kolleginnen und Kollegen von der Universität Graz und ich aber zu dem Schluss, dass das nicht nötig ist: Die Menschenrechte sind bereits ausreichend, wie sie sind.

Warum brauchen das Gehirn und die geistige Privatsphäre Ihrer Meinung nach keinen besonderen Schutz?

Die Forderung nach einem neuen Menschenrecht basiert auf einer sehr verkürzten Sicht darauf, wie neuronale Aktivität und Gedanken zusammenhängen. Das Gehirn ist nur eine von mehreren materiellen Grundlagen für geistige Prozesse. Die allgemeinen Menschenrechte, die jede Person als Ganzes schützen, sind bereits viel umfassender. Die Anwendung von Neurotechnologie hat außerdem immer eine kulturelle und soziale Ebene, diese geht bei bloßer Reduktion auf das Gehirn verloren. Daher denken wir, dass es kein neues Menschenrecht braucht. Trotzdem wird der Schutz vor neuronaler Manipulation und Ausspähung zunehmend wichtiger. Er sollte aber auf der Ebene des Verbraucherschutzes und der Regulierung von Medizinprodukten angesiedelt sein.

Welche technologischen Entwicklungen haben überhaupt zu der Forderung nach Neurorechten geführt?

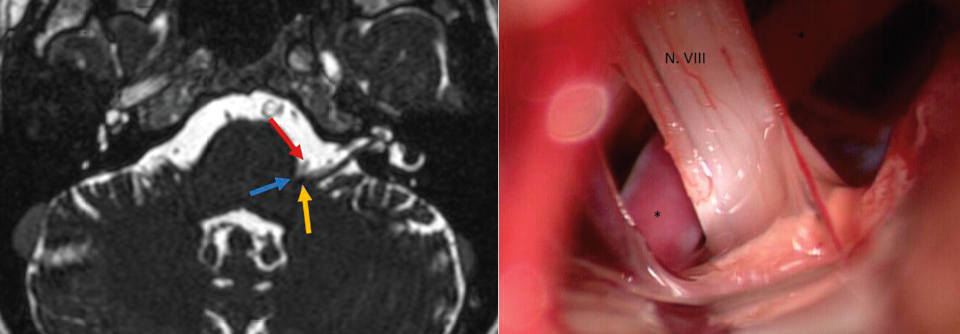

Mithilfe von invasiven Gehirn-Computer-Schnittstellen können Patientinnen und Patienten mit einem Locked-in-Syndrom bereits mit ihrer Umgebung kommunizieren, ohne einen einzigen Muskel zu bewegen – das kommt dem oft beschworenen „Gedankenlesen“ bislang am nächsten. Weitere Anwendungsgebiete sind die Steuerung von Prothesen oder die neuropsychologische Rehabilitation. Mithilfe solcher Arrays lassen sich aber auch Computerspiele steuern, wie die erste Testperson des „Neuralink“-Systems demonstrierte.

Insgesamt besteht im Moment eine recht optimistische Stimmung dahingehend, was sich alles mit Neurotechnologie erreichen lässt. Das Bewusstsein für mögliche Risiken ist dagegen eher gering ausgeprägt, auch bei eher gut ausgebildeten, jüngeren Personen. Ich halte das für gefährlich.

Welche Gefahren drohen durch solche Technologien?

Naheliegend sind zum einen direkte gesundheitliche Risiken, vor allem bei invasiven Technologien. Nicht nur kann jede OP Komplikationen verursachen, auch das Hirngewebe reagiert auf Fremdkörper und vernarbt mit der Zeit. Durch solche Vorgänge verliert jedes Microarray, das ins ZNS implantiert wird, nach einigen Jahren an Funktionalität. Es fallen nach und nach Kanäle aus, bis nur noch ein Bruchteil der ursprünglichen Kapazität vorhanden ist. Das bedeutet, man muss immer wieder neue Systeme implantieren. Die Nebenwirkungen sind noch völlig unbekannt. Es würde mich nicht wundern, wenn man im Langzeitverlauf etwa eine Zunahme an neurodegenerativen Prozessen durch die wiederholte Schädigung des Gehirns sieht. Aber noch fehlt es dazu an Daten.

Vorbild Lateinamerika?

Ende 2021 hat Chile als erstes Land der Welt Neurorechte in seiner Verfassung verankert. In Artikel 19 heißt es seitdem, dass „die Gehirnaktivität und daraus gewonnene Informationen“ geschützt sind. Ein begleitendes Gesetz legt Rechte u. a. in Bezug auf den freien Willen und die mentale Privatsphäre fest. Ähnliche Bestrebungen zu einer Verfassungsänderung und einer Gesetzesinitiative gibt es derzeit in Mexiko.

Auch gesellschaftliche Risiken werden diskutiert. Was gibt es dabei zu beachten?

Ein Gehirnchip verursacht eine weitreichende Abhängigkeit vom Betreiber des Systems. In den USA gab es eine Firma, die bionische Augenimplantate entwickelt hat. Diese wurden mehr als 350 blinden Patientinnen und Patienten mit Retinitis pigmentosa eingesetzt. Das Unternehmen geriet in finanzielle Schwierigkeiten und stellte 2020 die Unterstützung für das System ein. Die Betroffenen stehen seitdem ohne technischen Support oder Ersatzteile da, was in einigen Fällen zum erneuten Verlust des Sehvermögens führte. Auch wenn das Implantat funktionslos geworden ist, können die Träger zum Beispiel keinen Kernspintomographen mehr nutzen. Für diese vermehrten medizinischen Probleme muss letztlich die Gesellschaft aufkommen.

Invasive Technologien lassen sich außerdem – auch wenn es aktuell noch nach Science-Fiction klingt – hacken oder angreifen. Wenn viele Menschen Gehirn-Computer-Schnittstellen hätten, könnte man so vielleicht das Verhalten einer Gesellschaft im großen Stil manipulieren, zumindest bestünde die Gefahr von Sabotage. Und dann wäre da noch das Thema Gerechtigkeit: Angenommen, es gäbe einen Chip, der übermenschliche Intelligenz verleiht. Wer sollte Zugang zu dieser Technologie erhalten? Können sich dann nur reiche, ohnehin privilegierte Menschen eine neurotechnologische Optimierung leisten?

Sie würden also nicht sagen, dass mögliche Chancen der Neurotechnologie die Risiken überwiegen können?

Bei einer medizinischen Nutzung sehe ich das weniger kritisch. Wenn es darum geht, schwer erkrankten Personen ein Stück Lebensqualität und Würde zurückzugeben, kann man über viele der Risiken hinwegsehen. Seit einigen Jahren gibt es jedoch ein massives wirtschaftliches Interesse daran, diese Technologien aus dem medizinischen Bereich in die breite Gesellschaft zu tragen, etwa von der bereits erwähnten Firma Neuralink. Hier wiegt der mögliche Nutzen die genannten Risiken bei Weitem nicht auf.

Verletzen auch schon Social-Media-Algorithmen wie der von TikTok die Neurorechte? Einigen Forschenden zufolge wird dabei ja das Dopaminsystem so ausgenutzt, dass wir möglichst lange am Handy bleiben.

Das gehört definitiv dazu, denn auch dabei wird menschliches Verhalten technologisch beeinflusst. In den vergangenen Jahren haben deshalb mehrere Regierungen damit begonnen, den Zugang zu sozialen Medien und zu KI-Anwendungen für Minderjährige zu beschränken.

Nächstes Jahr wird die UNESCO dazu ein neues Dokument veröffentlichen, in dem es explizit auch um nicht-invasive Technologien geht. Das Ziel ist, in der digitalisierten Welt eine humanistische Haltung zu bewahren. Eine breite Definition von Neurotechnologie umfasst etwa auch Virtual-Reality-Anwendungen oder die Profilierung von Personen anhand ihrer Mediennutzungsdaten. Letzteres kann schon jetzt genutzt werden, um mentale Zustände erstaunlich präzise zu identifizieren und Inhalte auszuspielen, die gezielt das Verhalten beeinflussen sollen.

Medical-Tribune-Interview

Falls Sie diesen Medizin Cartoon gerne für Ihr nicht-kommerzielles Projekt oder Ihre Arzt-Homepage nutzen möchten, ist dies möglich: Bitte nennen Sie hierzu jeweils als Copyright den Namen des jeweiligen Cartoonisten, sowie die „MedTriX GmbH“ als Quelle und verlinken Sie zu unserer Seite https://www.medical-tribune.de oder direkt zum Cartoon auf dieser Seite. Bei weiteren Fragen, melden Sie sich gerne bei uns (Kontakt).